Warum dieser Artikel?

Einleitung

Seit Februar 2025 ist im Rahmen der KI-Verordnung (EU-AI-ACT) die Pflicht zum Nachweis von KI-Kompetenz für Unternehmen in Kraft getreten und gilt für alle Nutzer und Entwickler von KI und KI-Systemen. Doch was genau unter KI-Kompetenz fällt, warum diese gebraucht wird und wieso diese im Rahmen von vertrauenswürdigen KI-Systemen eine Schlüsselrolle einnimmt, ist häufig nicht klar.

In diesem Beitrag möchte ich eine kompakte Zusammenfassung zu den Hintergründen und möglichen Inhalten geben.

Inhalt und Aufbau des Artikels

In diesem Artikel möchte ich auf folgende Punkte eingehen:

Warum braucht es KI-Kompetenz?

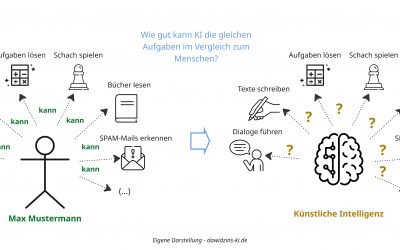

Um es gleich vorwegzunehmen: KI und die Kompetenz, diese zu entwickeln und mit ihr umzugehen, sind keine neuen Themenfelder. Die KI-Entwicklung geht bereits bis in die 50er-Jahre zurück, neuronale Netze gab es bereits in den 80ern, und Anfang der 2000er-Jahre war KI bereits in den meisten Anwendungen enthalten. Damals bezeichnete man „KI“ jedoch noch überwiegend als Algorithmus oder Expertensystem, welche zumeist im Hintergrund arbeiteten. KI-Kompetenz mussten damit in der Regel nur die Personen haben, welche solche Systeme oder Algorithmen entwickelten oder direkt mit diesen arbeiteten. Dadurch wird jedoch bereits der Unterschied zu heute deutlich: Aktuelle KI ist im Vergleich zu den 2000er-Jahren um ein Vielfaches leistungsfähiger, komplexer und vor allem einer viel größeren und breiteren Masse an Personen und Firmen zugänglich.

Wo es für die Entwicklung von KI-Systemen vorher umfangreiche Expertise, Experten und spezialisierte Firmen mit großer Infrastruktur brauchte, können heute auch kleine Unternehmen und Einzelpersonen ohne große Ressourcen eigene (generative) KI-Systeme entwickeln, betreiben oder einsetzen. Das Gleiche gilt für die Anwendungsmöglichkeiten und Interaktionsmöglichkeiten von KI. Privatpersonen können heute in einem nie gekannten Maße KI-Systeme nutzen und universell einsetzen. Dialog- und Chatsystemen wie ChatGPT, Copilot und Co. sei Dank.

Daraus ergeben sich zwei große Ziel- und Interessengruppen:

-

Gruppe 1: Die Anbieter, Betreiber und Entwickler von KI-Systemen.

-

Gruppe 2: Die Nutzer von KI-Systemen.

Dies führt zu deutlich mehr Risiken und Risikofeldern. Durch die deutlich erleichterten Möglichkeiten, KI-Systeme auch ohne tiefergehende Expertise entwickeln, anbieten und nutzen zu können, steigt auch das Risiko, dass diese Systeme nicht wie gewünscht funktionieren oder zu Schäden und unerwarteten Problemen führen. KI-Systeme sind mitunter schnell entwickelt und in Betrieb genommen. Die Herausforderung ist jedoch, dafür zu sorgen, dass diese auch sicher und wie gewünscht funktionieren. Wer sich wundert, warum wir noch immer keine autonomen Autos haben, dem sei versichert, dass dies nicht an der Bequemlichkeit der Entwickler und Firmen liegt. Die Ermittlung, Mitigation und Prüfung aller beim autonomen Fahren potenziell möglichen Risiken ist einfach extrem komplex und zeitaufwendig. Und bei solchen Use Cases handelt es sich in der Regel um geschlossene Systeme, bei welchen Nutzer (im Optimalfall) keinen Einfluss auf die Funktionsweise von außen haben. KI-Systeme zu entwickeln ist in der Praxis tatsächlich gar nicht so kompliziert.

Aus diesem Grund stehen die Nutzer der Gruppe 2 in Verbindung mit sogenannten KI-Systemen mit allgemeinem Verwendungszweck (General Purpose AI – GPAI) besonders im Fokus. GPAI beschreibt Systeme und Modelle, welche nicht zweckgebunden bzw. auf die Ausführung einer Aufgabe beschränkt sind, sondern eine Vielzahl an potenziellen Anwendungsmöglichkeiten bieten (dazu in einem anderen Kapitel mehr). Bei solchen Systemen bzw. Modellen handelt es sich aktuell überwiegend um sogenannte Large Language Models, welche hinter Anwendungen wie ChatGPT, CoPilot und Co. stecken und stellvertretend für generative KI stehen.

Die wenigsten Nutzer sind sich jedoch über die Funktionsweise der Modelle im Hintergrund oder der Systeme bewusst und welche Implikationen diese bei der Ein- und Ausgabe von Daten haben können. So haben viele bereits festgestellt, dass solche KI-Systeme gerne mal falsche, wechselnde oder fehlerhafte Antworten generieren, aber warum und in welchen Situationen dies geschieht, ist schwer nachzuvollziehen. Eignen sich solche KI-Systeme, wo man als Nutzer nicht nachvollziehen kann, wie und warum eine Antwort generiert wird, für sensible Aufgaben wie die Klassifikation von Bewerbungen oder die Diagnose von Krankheitsbildern? Als Laie und ohne umfangreiche Prüfung schwer nachvollziehbar. Gleiches gilt für Datenschutz und Sicherheit. Nach wie vor ist es nicht jedem klar, dass Eingaben bei ChatGPT ohne explizites „Opt-out“ bzw. spezielle Abo-Modelle zum Training neuer Modelle genutzt werden. Sensible Informationen, welche einmal bei ChatGPT eingegeben wurden, können so allen Nutzern zugänglich gemacht werden. Möchte man dies und wie bekommt man eigentlich einmal trainiertes Wissen wieder aus einer KI heraus?

KI-Kompetenz braucht damit jeder, welcher KI-Systeme vertrauensvoll, rechtskonform und sicher einsetzen oder entwickeln will. Was KI-Kompetenz nun genau umfassen oder sein soll, dazu kommen wir jetzt.

Was ist KI-Kompetenz?

In der Praxis ist es tatsächlich gar nicht so einfach zu definieren, was KI-Kompetenz nun genau ist oder sein soll, da diese immer abhängig vom jeweiligen Anwendungskontext und Vorwissen betrachtet werden muss. Ein Entwickler von KI (Gruppe 1) braucht anderes Fachwissen oder Verständnis von Risiken und Funktionsweise eines KI-Systems als ein Nutzer (Gruppe 2), und selbst bei der Nutzung kann es große Unterschiede je nach Schwerpunkt eines KI-Systems geben.

Ähnlich unscharf wird deshalb auch die KI-Kompetenz in der KI-Verordnung (EU-AI-Act) definiert. Art. 3 Nr. 56 KI-VO definiert KI-Kompetenz wie folgt:

„die Fähigkeiten, die Kenntnisse und das Verständnis, die es Anbietern, Betreibern und Betroffenen unter Berücksichtigung ihrer jeweiligen Rechte und Pflichten im Rahmen dieser Verordnung ermöglichen, KI-Systeme sachkundig einzusetzen sowie sich der Chancen und Risiken von KI und möglicher Schäden, die sie verursachen kann, bewusst zu werden“.

Neben dem Wissen um die potenziellen Einsatzmöglichkeiten bedeutet dies, dass Nutzer und Entwickler insbesondere umfangreiches Wissen über mögliche Risiken, Gefahren und rechtliche Implikationen haben müssen. Dies schließt auch ein Verständnis der Funktionsweise ein, da sich erst durch ein bzw. das Wissen um die Funktionsweise ein allgemeingültiges Verständnis für mögliche Risiken einstellt, welches nicht auf feste Use Cases beschränkt ist.

KI-Kompetenz in der Praxis

KI-Kompetenz in der Praxis

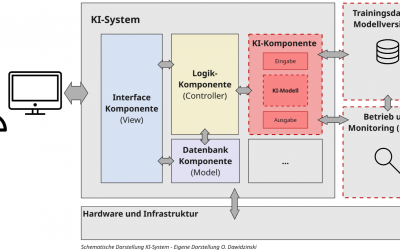

Was bedeutet dies nun in der Praxis? Konkret bedeutet dies meiner Meinung nach nun Wissen zu (mindestens) den folgenden Punkten:

-

Wissen zur Funktionsweise und zu Trainingsprozessen von KI-Systemen

-

Verständnis über die möglichen Einsatzszenarien und Use Cases

-

Wissen über Gefahren, Risiken und Mitigationsmöglichkeiten zu folgenden Risikofeldern:

-

Risikokategorien nach EU-AI-Act

-

Fairness

-

Autonomie & Kontrolle

-

Transparenz

-

Verlässlichkeit

-

Sicherheit

-

Datenschutz

-

Governance & Compliance

-

-

Verständnis über rechtliche Rahmenbedingungen, Gesetze und Regulierungen

-

EU-AI-Act

-

Data Act

-

DSGVO

-

Weitere abhängig von der jeweiligen Branche (…)

-

Dabei ist zu beachten, dass der Detailgrad des Wissens immer individuell vom Anwendungsfall und Nutzungsszenario abhängig gemacht werden sollte. Nutzer, welche ChatGPT in unkritischen Bereichen in Einklang mit einer unternehmenseigenen AI-Policy einsetzen, brauchen kein tiefergehendes Verständnis über Bias-Variance-Tradeoffs oder Class-Balancing, wie ein AI-Engineer, welcher eigene Modelle trainiert und entwickelt.

In der Praxis wird es vermutlich am praktikabelsten sein, wenn es eine allgemeine Grundlagenschulung gibt, in welcher alle Themen grundlegend und allgemein abgehandelt werden. Darauf aufbauend bietet es sich dann an, individuelle Aufbau- und Vertiefungsschulungen aufzusetzen oder anzubieten, welche sich an den konkreten Einsatzszenarien, Risikopotenzialen und Tools orientieren.

Die (gesetzliche) Notwendigkeit von KI-Kompetenz nach KI-VO / EU-AI-ACT

Neben der allgemeinen (und intrinsischen) Notwendigkeit, über genügend Kompetenz für den verantwortungsvollen Einsatz oder die Entwicklung von KI zu verfügen, gibt es seit dem 02.02.2025 (Art. 113 lit. a KI-VO) nun auch die gesetzliche Vorgabe:

In Art. 4 der KI-VO wird Folgendes von Anbietern und Betreibern gesetzlich verlangt:

„Die Anbieter und Betreiber von KI-Systemen ergreifen Maßnahmen, um nach besten Kräften sicherzustellen, dass ihr Personal und andere Personen, die in ihrem Auftrag mit dem Betrieb und der Nutzung von KI-Systemen befasst sind, über ein ausreichendes Maß an KI-Kompetenz verfügen, wobei ihre technischen Kenntnisse, ihre Erfahrung, ihre Ausbildung und Schulung und der Kontext, in dem die KI-Systeme eingesetzt werden sollen, sowie die Personen oder Personengruppen, bei denen die KI-Systeme eingesetzt werden sollen, zu berücksichtigen sind.“

Damit ist die KI-Kompetenz ab sofort von einer freiwilligen Arbeit zu einer verpflichtenden Komponente geworden für deren Überwachung voraussichtlich die Bundesnetzagentur verantwortlich sein wird.

In meinem zweiten Teil zur KI-Kompetenz, werde ich auf die Unterschiede und Gemeinsamkeiten zwischen KI, Data Science, Data Mining und Co. eingehen: KI-Kompetenz (Teil 2): Der Unterschied zwischen KI, Data Science und Co.

0 Kommentare